Big Data. Анализ больших данных

Постоянное ускорение роста объема данных является неотъемлемым элементом современных реалий. Социальные сети, мобильные устройства, данные с измерительных устройств, бизнес-информация – это лишь несколько видов источников, способных генерировать гигантские массивы данных.

В настоящее время термин Big Data (Большие данные) стал довольно распространенным. Далеко не все еще осознают то, насколько быстро и глубоко технологии обработки больших массивов данных меняют самые различные аспекты жизни общества. Перемены происходят в различных сферах, порождая новые проблемы и вызовы, в том числе и в сфере информационной безопасности, где на первом плане должны находиться такие важнейшие ее аспекты, как конфиденциальность, целостность, доступность и т. д.

К сожалению, многие современные компании прибегают к технологии Big Data, не создавая для этого надлежащей инфраструктуры, которая смогла бы обеспечить надежное хранение огромных массивов данных, которые они собирают и хранят. С другой стороны, в настоящее время стремительно развивается технология блокчейн, которая призвана решить эту и многие другие проблемы.

Что такое Big Data?

По сути, определение термина лежит на поверхности: «большие данные» означают управление очень большими объемами данных, а также их анализ. Если смотреть шире, то это информация, которая не поддается обработке классическими способами по причине ее больших объемов.

Сам термин Big Data (большие данные) появился относительно недавно. Согласно данным сервиса Google Trends , активный рост популярности термина приходится на конец 2011 года:

В 2010 году уже стали появляться первые продукты и решения, непосредственно связанные с обработкой больших данных. К 2011 году большинство крупнейших IT-компаний, включая IBM, Oracle, Microsoft и Hewlett-Packard, активно используют термин Big Data в своих деловых стратегиях. Постепенно аналитики рынка информационных технологий начинают активные исследования данной концепции.

В настоящее время этот термин приобрел значительную популярность и активно используется в самых различных сферах. Однако нельзя с уверенностью сказать, что Big Data – это какое-то принципиально новое явление – напротив, большие источники данных существуют уже много лет. В маркетинге ими можно назвать базы данных по покупкам клиентов, кредитным историям, образу жизни и т. д. На протяжении многих лет аналитики использовали эти данные, чтобы помогать компаниям прогнозировать будущие потребности клиентов, оценивать риски, формировать потребительские предпочтения и т. д.

В настоящее время ситуация изменилась в двух аспектах:

— появились более сложные инструменты и методы для анализа и сопоставления различных наборов данных;

— инструменты анализа дополнились множеством новых источников данных, что обусловлено повсеместным переходом на цифровые технологии, а также новыми методами сбора и измерения данных.

Исследователи прогнозируют, что технологии Big Data активнее всего будут использоваться в производстве, здравоохранении, торговле, госуправлении и в других самых различных сферах и отраслях.

Big Data – это не какой-либо определенный массив данных, а совокупность методов их обработки. Определяющей характеристикой для больших данных является не только их объем, но также и другие категории, характеризующие трудоемкие процессы обработки и анализа данных.

В качестве исходных данных для обработки могут выступать, например:

— логи поведения интернет-пользователей;

— Интернет вещей;

— социальные медиа;

— метеорологические данные;

— оцифрованные книги крупнейших библиотек;

— GPS-сигналы из транспортных средств;

— информация о транзакциях клиентов банков;

— данные о местонахождении абонентов мобильных сетей;

— информация о покупках в крупных ритейл-сетях и т.д.

Со временем объемы данных и количество их источников непрерывно растет, а на этом фоне появляются новые и совершенствуются уже имеющиеся методы обработки информации.

Основные принципы Big Data:

— Горизонтальная масштабируемость – массивы данных могут быть огромными и это значит, что система обработки больших данных должна динамично расширяться при увеличении их объемов.

— Отказоустойчивость – даже при сбое некоторых элементов оборудования, вся система должна оставаться работоспособной.

— Локальность данных. В больших распределенных системах данные обычно распределяются по значительному числу машин. Однако по мере возможности и в целях экономии ресурсов данные часто обрабатываются на том же сервере, что и хранятся.

Для стабильной работы всех трех принципов и, соответственно, высокой эффективности хранения и обработки больших данных необходимы новые прорывные технологии, такие как, например, блокчейн.

Для чего нужны большие данные?

Сфера применения Big Data постоянно расширяется:

— Большие данные можно использовать в медицине. Так, устанавливать диагноз пациенту можно не только опираясь на данные анализа истории болезни, но также принимая во внимание опыт других врачей, сведения об экологической ситуации района проживания больного и многие другие факторы.

— Технологии Big Data могут использоваться для организации движения беспилотного транспорта.

— Обрабатывая большие массивы данных можно распознавать лица на фото- и видеоматериалах.

— Технологии Big Data могут быть использованы ритейлерами – торговые компании могут активно использовать массивы данных из социальных сетей для эффективной настройки своих рекламных кампаний, которые могут быть максимально ориентированы под тот или иной потребительский сегмент.

— Данная технология активно используется при организации предвыборных кампаний, в том числе для анализа политических предпочтений в обществе.

— Использование технологий Big Data актуально для решений класса гарантирования доходов (RA) , которые включают в себя инструменты обнаружения несоответствий и углубленного анализа данных, позволяющие своевременно выявить вероятные потери, либо искажения информации, способные привести к снижению финансовых результатов.

— Телекоммуникационные провайдеры могут агрегировать большие данные, в том числе о геолокации; в свою очередь эта информация может представлять коммерческий интерес для рекламных агентств, которые могут использовать ее для показа таргетированной и локальной рекламы, а также для ритейлеров и банков.

— Большие данные могут сыграть важную роль при решении открытия торговой точки в определенной локации на основе данных о наличии мощного целевого потока людей.

Таким образом наиболее очевидное практическое применение технологии Big Data лежит в сфере маркетинга. Благодаря развитию интернета и распространению всевозможных коммуникационных устройств поведенческие данные (такие как число звонков, покупательские привычки и покупки) становятся доступными в режиме реального времени.

Технологии больших данных могут также эффективно использоваться в финансах, для социологических исследований и во многих других сферах. Эксперты утверждают, что все эти возможности использования больших данных являются лишь видимой частью айсберга, поскольку в гораздо больших объемах эти технологии используются в разведке и контрразведке, в военном деле, а также во всем том, что принято называть информационными войнами.

В общих чертах последовательность работы с Big Data состоит из сбора данных, структурирования полученной информации с помощью отчетов и дашбордов, а также последующего формулирования рекомендаций к действию.

Рассмотрим вкратце возможности использования технологий Big Data в маркетинге. Как известно, для маркетолога информация – главный инструмент для прогнозирования и составления стратегии. Анализ больших данных давно и успешно применяется для определения целевой аудитории, интересов, спроса и активности потребителей. Анализ больших данных, в частности, позволяет выводить рекламу (на основе модели RTB-аукциона - Real Time Bidding) только тем потребителям, которые заинтересованы в товаре или услуге.

Применение Big Data в маркетинге позволяет бизнесменам:

— лучше узнавать своих потребителей, привлекать аналогичную аудиторию в Интернете;

— оценивать степень удовлетворенности клиентов;

— понимать, соответствует ли предлагаемый сервис ожиданиям и потребностям;

— находить и внедрять новые способы, увеличивающие доверие клиентов;

— создавать проекты, пользующиеся спросом и т. д.

Например, сервис Google.trends может указать маркетологу прогноз сезонной активности спроса на конкретный продукт, колебания и географию кликов. Если сопоставить эти сведения со статистическими данными, собираемыми соответствующим плагином на собственном сайте, то можно составить план по распределению рекламного бюджета с указанием месяца, региона и других параметров.

По мнению многих исследователей, именно в сегментации и использовании Big Data заключается успех предвыборной кампании Трампа. Команда будущего президента США смогла правильно разделить аудиторию, понять ее желания и показывать именно тот месседж, который избиратели хотят видеть и слышать. Так, по мнению Ирины Белышевой из компании Data-Centric Alliance, победа Трампа во многом стала возможной благодаря нестандартному подходу к интернет-маркетингу, в основу которого легли Big Data, психолого-поведенческий анализ и персонализированная реклама.

Политтехнологи и маркетологи Трампа использовали специально разработанную математическую модель, которая позволила глубоко проанализировать данные всех избирателей США систематизировать их, сделав сверхточный таргетинг не только по географическим признаками, но также и по намерениям, интересам избирателей, их психотипу, поведенческим характеристикам и т. д. После этого маркетологи организовали персонализированную коммуникацию с каждой из групп граждан на основе их потребностей, настроений, политических взглядов, психологических особенностей и даже цвета кожи, используя практически для каждого отдельного избирателя свой месседж.

Что касается Хиллари Клинтон, то она в своей кампании использовала «проверенные временем» методы, основанные на социологических данных и стандартном маркетинге, разделив электорат лишь на формально гомогенные группы (мужчины, женщины, афроамериканцы, латиноамериканцы, бедные, богатые и т. д.).

В результате выиграл тот, кто по достоинству оценил потенциал новых технологий и методов анализа. Примечательно, что расходы на предвыборную кампанию Хиллари Клинтон были в два раза больше, чем у ее оппонента:

Данные: Pew Research

Основные проблемы использования Big Data

Помимо высокой стоимости, одним из главных факторов, тормозящих внедрение Big Data в различные сферы, является проблема выбора обрабатываемых данных: то есть определения того, какие данные необходимо извлекать, хранить и анализировать, а какие – не принимать во внимание.

Еще одна проблема Big Data носит этический характер. Другими словами возникает закономерный вопрос: можно ли подобный сбор данных (особенно без ведома пользователя) считать нарушением границ частной жизни?

Не секрет, что информация, сохраняемая в поисковых системах Google и Яндекс, позволяет IT-гигантам постоянно дорабатывать свои сервисы, делать их удобными для пользователей и создавать новые интерактивные приложения. Для этого поисковики собирают пользовательские данные об активности пользователей в интернете, IP-адреса, данные о геолокации, интересах и онлайн-покупках, личные данные, почтовые сообщения и т. д. Все это позволяет демонстрировать контекстную рекламу в соответствии с поведением пользователя в интернете. При этом обычно согласия пользователей на это не спрашивается, а возможности выбора, какие сведения о себе предоставлять, не дается. То есть по умолчанию в Big Data собирается все, что затем будет храниться на серверах данных сайтов.

Из этого вытекает следующая важная проблема, касающаяся обеспечения безопасности хранения и использования данных. Например, безопасна ли та или иная аналитическая платформа, которой потребители в автоматическом режиме передают свои данные? Кроме того, многие представители бизнеса отмечают дефицит высококвалифицированных аналитиков и маркетологов, способных эффективно оперировать большими объемами данных и решать с их помощью конкретные бизнес-задачи.

Несмотря на все сложности с внедрением Big Data, бизнес намерен увеличивать вложения в это направление. По данным исследования Gartner, лидерами инвестирующих в Big Data отраслей являются медиа, ритейл, телеком, банковский сектор и сервисные компании.

Перспективы взаимодействия технологий блокчейн и Big Data

Интеграция с Big Data несет в себе синергетический эффект и открывает бизнесу широкий спектр новых возможностей, в том числе позволяя:

— получать доступ к детализированной информации о потребительских предпочтениях, на основе которых можно выстраивать подробные аналитические профили для конкретных поставщиков, товаров и компонентов продукта;

— интегрировать подробные данные о транзакциях и статистике потребления определенных групп товаров различными категориями пользователей;

— получать подробные аналитические данные о цепях поставок и потребления, контролировать потери продукции при транспортировке (например, потери веса вследствие усыхания и испарения некоторых видов товаров);

— противодействовать фальсификациям продукции, повысить эффективность борьбы с отмыванием денег и мошенничеством и т. д.

Доступ к подробным данным об использовании и потреблении товаров в значительной мере раскроет потенциал технологии Big Data для оптимизации ключевых бизнес-процессов, снизит регуляторные риски, раскроет новые возможности монетизации и создания продукции, которая будет максимально соответствовать актуальным потребительским предпочтениям.

Как известно, к технологии блокчейн уже проявляют значительный интерес представители крупнейших финансовых институтов, включая , и т. д. По мнению Оливера Буссманна, IT-менеджера швейцарского финансового холдинга UBS, технология блокчейн способна «сократить время обработки транзакций от нескольких дней до нескольких минут».

Потенциал анализа из блокчейна при помощи технологии Big Data огромен. Технология распределенного реестра обеспечивает целостность информации, а также надежное и прозрачное хранение всей истории транзакций. Big Data, в свою очередь, предоставляет новые инструменты для эффективного анализа, прогнозирования, экономического моделирования и, соответственно, открывает новые возможности для принятия более взвешенных управленческих решений.

Тандем блокчейна и Big Data можно успешно использовать в здравоохранении. Как известно, несовершенные и неполные данные о здоровье пациента в разы увеличивают риск постановки неверного диагноза и неправильно назначенного лечения. Критически важные данные о здоровье клиентов медучреждений должны быть максимально защищенными, обладать свойствами неизменности, быть проверяемыми и не должны быть подвержены каким-либо манипуляциям.

Информация в блокчейне соответствует всем перечисленным требованиям и может служить в роли качественных и надежных исходных данных для глубокого анализа при помощи новых технологий Big Data. Помимо этого, при помощи блокчейна медицинские учреждения смогли бы обмениваться достоверными данными со страховыми компаниями, органами правосудия, работодателями, научными учреждениями и другими организациями, нуждающимися в медицинской информации.

Big Data и информационная безопасность

В широком понимании, информационная безопасность представляет собой защищенность информации и поддерживающей инфраструктуры от случайных или преднамеренных негативных воздействий естественного или искусственного характера.

В области информационной безопасности Big Data сталкивается со следующими вызовами:

— проблемы защиты данных и обеспечения их целостности;

— риск постороннего вмешательства и утечки конфиденциальной информации;

— ненадлежащее хранение конфиденциальной информации;

— риск потери информации, например, вследствие чьих-либо злонамеренных действий;

— риск нецелевого использования персональных данных третьими лицами и т. д.

Одна из главных проблем больших данных, которую призван решить блокчейн, лежит в сфере информационной безопасности. Обеспечивая соблюдение всех основных ее принципов, технология распределенного реестра может гарантировать целостность и достоверность данных, а благодаря отсутствию единой точки отказа, блокчейн делает стабильной работу информационных систем. Технология распределенного реестра может помочь решить проблему доверия к данным, а также предоставить возможность универсального обмена ими.

Информация – ценный актив, а это значит, что на первом плане должен стоять вопрос обеспечения основных аспектов информационной безопасности. Для того, чтобы выстоять в конкурентной борьбе, компании должны идти в ногу со временем, а это значит, что им нельзя игнорировать те потенциальные возможности и преимущества, которые заключают в себе технология блокчейн и инструменты Big Data.

Обычно, когда говорят о серьезной аналитической обработке, особенно если используют термин Data Mining, подразумевают, что данных огромное количество. В общем случае это не так, т. к. довольно часто приходится обрабатывать небольшие наборы данных, и находить в них закономерности ничуть не проще, чем в сотнях миллионов записей. Хотя нет сомнений, что необходимость поиска закономерностей в больших базах данных усложняет и без того нетривиальную задачу анализа.

Такая ситуация особенно характерна для бизнеса, связанного с розничной торговлей, телекоммуникациями, банками, интернетом. В их базах данных аккумулируется огромное количество информации, связанной с транзакциями: чеки, платежи, звонки, логи и т.п.

Не существует универсальных способов анализа или алгоритмов, пригодных для любых случаев и любых объемов информации. Методы анализа данных существенно отличаются друг от друга по производительности, качеству результатов, удобству применения и требованиям к данным. Оптимизация может производиться на различных уровнях: оборудование, базы данных, аналитическая платформа, подготовка исходных данных, специализированные алгоритмы. Анализ большого объема данных требует особого подхода, т.к. технически сложно их переработать при помощи только "грубой силы", т.е. использования более мощного оборудования.

Конечно, можно увеличить скорость обработки данных за счет более производительного оборудования, тем более, что современные сервера и рабочие станции используют многоядерные процессоры, оперативную память значительных размеров и мощные дисковые массивы. Однако, есть множество других способов обработки больших объемов данных, которые позволяют повысить масштабируемость и не требуют бесконечного обновления оборудования.

Возможности СУБД

Современные базы данных включают различные механизмы, применение которых позволит значительно увеличить скорость аналитической обработки:

- Предварительный обсчет данных. Сведения, которые чаще всего используются для анализа, можно заранее обсчитать (например, ночью) и в подготовленном для обработки виде хранить на сервере БД в виде многомерных кубов, материализованных представлений, специальных таблиц.

- Кэширование таблиц в оперативную память. Данные, которые занимают немного места, но к которым часто происходит обращение в процессе анализа, например, справочники, можно средствами базы данных кэшировать в оперативную память. Так во много раз сокращаются обращения к более медленной дисковой подсистеме.

- Разбиение таблиц на разделы и табличные пространства. Можно размещать на отдельных дисках данные, индексы, вспомогательные таблицы. Это позволит СУБД параллельно считывать и записывать информацию на диски. Кроме того, таблицы могут быть разбиты на разделы (partition) таким образом, чтобы при обращении к данным было минимальное количество операций с дисками. Например, если чаще всего мы анализируем данные за последний месяц, то можно логически использовать одну таблицу с историческими данными, но физически разбить ее на несколько разделов, чтобы при обращении к месячным данным считывался небольшой раздел и не было обращений ко всем историческим данным.

Это только часть возможностей, которые предоставляют современные СУБД. Повысить скорость извлечения информации из базы данных можно и десятком других способов: рациональное индексирование, построение планов запросов, параллельная обработка SQL запросов, применение кластеров, подготовка анализируемых данных при помощи хранимых процедур и триггеров на стороне сервера БД и т.п. Причем многие из этих механизмов можно использовать с применением не только "тяжелых" СУБД, но и бесплатных баз данных.

Комбинирование моделей

Возможности повышения скорости не сводятся только к оптимизации работы базы данных, многое можно сделать при помощи комбинирования различных моделей. Известно, что скорость обработки существенно связана со сложностью используемого математического аппарата. Чем более простые механизмы анализа используются, тем быстрее данные анализируются.

Возможно построение сценария обработки данных таким образом, чтобы данные "прогонялись" через сито моделей. Тут применяется простая идея: не тратить время на обработку того, что можно не анализировать.

Вначале используются наиболее простые алгоритмы. Часть данных, которые можно обработать при помощи таких алгоритмов и которые бессмысленно обрабатывать с использованием более сложных методов, анализируется и исключается из дальнейшей обработки. Оставшиеся данные передаются на следующий этап обработки, где используются более сложные алгоритмы, и так далее по цепочке. На последнем узле сценария обработки применяются самые сложные алгоритмы, но объем анализируемых данных во много раз меньше первоначальной выборки. В результате общее время, необходимое для обработки всех данных, уменьшается на порядки.

Приведем практический пример использования этого подхода. При решении задачи прогнозирования спроса первоначально рекомендуется провести XYZ-анализ, который позволяет определить, насколько стабилен спрос на различные товары. Товары группы X продаются достаточно стабильно, поэтому применение к ним алгоритмов прогнозирования позволяет получить качественный прогноз. Товары группы Y продаются менее стабильно, возможно для них стоит строить модели не для каждого артикула, а для группы, это позволяет сгладить временной ряд и обеспечить работу алгоритма прогнозирования. Товары группы Z продаются хаотично, поэтому для них вообще не стоит строить прогностические модели, потребность в них нужно рассчитывать на основе простых формул, например, среднемесячных продаж.

По статистике около 70 % ассортимента составляют товары группы Z. Еще около 25 % - товары группы Y и только примерно 5 % - товары группы X. Таким образом, построение и применение сложных моделей актуально максимум для 30 % товаров. Поэтому применение описанного выше подхода позволит сократить время на анализ и прогнозирование в 5-10 раз.

Параллельная обработка

Еще одной эффективной стратегией обработки больших объемов данных является разбиение данных на сегменты и построение моделей для каждого сегмента по отдельности, с дальнейшим объединением результатов. Чаще всего в больших объемах данных можно выделить несколько отличающихся друг от друга подмножеств. Это могут быть, например, группы клиентов, товаров, которые ведут себя схожим образом и для которых целесообразно строить одну модель.

В этом случае вместо построения одной сложной модели для всех можно строить несколько простых для каждого сегмента. Подобный подход позволяет повысить скорость анализа и снизить требования к памяти благодаря обработке меньших объемов данных в один проход. Кроме того, в этом случае аналитическую обработку можно распараллелить, что тоже положительно сказывается на затраченном времени. К тому же модели для каждого сегмента могут строить различные аналитики.

Помимо повышения скорости этот подход имеет и еще одно важное преимущество – несколько относительно простых моделей по отдельности легче создавать и поддерживать, чем одну большую. Можно запускать модели поэтапно, получая таким образом первые результаты в максимально сжатые сроки.

Репрезентативные выборки

При наличии больших объемов данных можно использовать для построения модели не всю информацию, а некоторое подмножество – репрезентативную выборку. Корректным образом подготовленная репрезентативная выборка содержит в себе информацию, необходимую для построения качественной модели.

Процесс аналитической обработки делится на 2 части: построение модели и применение построенной модели к новым данным. Построение сложной модели – ресурсоемкий процесс. В зависимости от применяемого алгоритма данные кэшируются, сканируются тысячи раз, рассчитывается множество вспомогательных параметров и т.п. Применение же уже построенной модели к новым данным требует ресурсов в десятки и сотни раз меньше. Очень часто это сводится к вычислению нескольких простых функций.

Таким образом, если модель будет строиться на относительно небольших множествах и применяться в дальнейшем ко всему набору данных, то время получения результата сократится на порядки по сравнению с попыткой полностью переработать весь имеющийся набор данных.

Для получения репрезентативных выборок существуют специальные методы, например, сэмплинг. Их применение позволяет повышать скорость аналитической обработки, не жертвуя качеством анализа.

Резюме

Описанные подходы – это только небольшая часть методов, которые позволяют анализировать огромные объемы данных. Существуют и другие способы, например, применение специальных масштабируемых алгоритмов, иерархических моделей, обучение окнами и прочее.

Анализ огромных баз данных – это нетривиальная задача, которая в большинстве случаев не решается "в лоб", однако современные базы данных и аналитические платформы предлагают множество методов решения этой задачи. При разумном их применении системы способны перерабатывать терабайты данных с приемлемой скоростью.

По материалам research&trends

Big Data, «Большие данные» вот уже несколько лет как стали притчей во языцех в IT-и маркетинговой прессе. И понятно: цифровые технологии пронизали жизнь современного человека, «все пишется». Объем данных о самых разных сторонах жизни растет, и одновременно растут возможности хранения информации.

Глобальные технологии для хранения информации

Источник: Hilbert and Lopez, `The world"s technological capacity to store, communicate, and compute information,`Science, 2011 Global.

Большинство экспертов сходятся во мнении, что ускорение роста объема данных является объективной реальностью. Социальные сети, мобильные устройства, данные с измерительных устройств, бизнес-информация – вот лишь несколько видов источников, способных генерировать гигантские объемы информации. По данным исследования IDC Digital Universe , опубликованного в 2012 году, ближайшие 8 лет количество данных в мире достигнет 40 Зб (zettabytes) что эквивалентно 5200 Гб на каждого жителя планеты.

Рост собираемой цифровой информации в США

Источник: IDC

Значительную часть информации создают не люди, а роботы, взаимодействующие как друг с другом, так и с другими сетями данных – такие, как, например, сенсоры и интеллектуальные устройства. При таких темпах роста количество данных в мире, по прогнозам исследователей, будет ежегодно удваиваться. Количество виртуальных и физических серверов в мире вырастет десятикратно за счет расширения и создания новых data-центров. В связи с этим растет потребность в эффективном использовании и монетизации этих данных. Поскольку использование Big Data в бизнесе требует немалых инвестиций, то надо ясно понимать ситуацию. А она, в сущности, проста: повысить эффективность бизнеса можно сокращая расходы или/и увеличивая объем продаж.

Для чего нужны Big Data

Парадигма Big Data определяет три основных типа задач.

- Хранение и управление объемом данных в сотни терабайт или петабайт, которые обычные реляционные базы данных не позволяют эффективно использовать.

- Организация неструктурированной информации, состоящей из текстов, изображений, видео и других типов данных.

- Анализ Big Data, который ставит вопрос о способах работы с неструктурированной информацией, генерацию аналитических отчетов, а также внедрение прогностических моделей.

Рынок проектов Big Data пересекается с рынком бизнес-аналитики (BA), объем которого в мире, по оценкам экспертов, в 2012 году составил около 100 млрд. долларов. Он включает в себя компоненты сетевых технологий, серверов, программного обеспечения и технических услуг.

Также использование технологий Big Data актуально для решений класса гарантирования доходов (RA), предназначенных для автоматизации деятельности компаний. Современные системы гарантирования доходов включают в себя инструменты обнаружения несоответствий и углубленного анализа данных, позволяющие своевременно обнаружить возможные потери, либо искажение информации, способные привести к снижению финансовых результатов. На этом фоне российские компании, подтверждающие наличие спроса технологий Big Data на отечественном рынке, отмечают, что факторами, которые стимулируют развитие Big Data в России, являются рост данных, ускорение принятия управленческих решений и повышение их качества.

Что мешает работать с Big Data

Сегодня анализируется только 0,5% накопленных цифровых данных, несмотря на то, что объективно существуют общеотраслевые задачи, которые можно было бы решить с помощью аналитических решений класса Big Data. Развитые IT-рынки уже имеют результаты, по которым можно оценить ожидания, связанные с накоплением и обработкой больших данных.

Одним из главных факторов, который тормозит внедрение Big Data - проектов, помимо высокой стоимости, считается проблема выбора обрабатываемых данных : то есть определение того, какие данные необходимо извлекать, хранить и анализировать, а какие – не принимать во внимание.

Многие представители бизнеса отмечают, что сложности при внедрении Big Data-проектов связаны с нехваткой специалистов – маркетологов и аналитиков. От качества работы сотрудников, занимающихся глубинной и предикативной аналитикой, напрямую зависит скорость возврата инвестиций в Big Data. Огромный потенциал уже существующих в организации данных часто не может быть эффективно использован самими маркетологами из-за устаревших бизнес-процессов или внутренних регламентов. Поэтому часто проекты Big Data воспринимаются бизнесом как сложные не только в реализации, но и в оценке результатов: ценности собранных данных. Специфика работы с данными требует от маркетологов и аналитиков переключения внимания с технологий и создания отчетов на решение конкретных бизнес-задач.

В связи с большим объемом и высокой скоростью потока данных, процесс их сбора предполагает процедуры ETL в режиме реального времени. Для справки: ETL – от англ. Extract , Transform , Load - дословно «извлечение, преобразование, загрузка») - один из основных процессов в управлении хранилищами данных, который включает в себя: извлечение данных из внешних источников, их трансформацию и очистку с целью соответствия нуждам ETL следует рассматривать не только как процесс переноса данных из одного приложения в другое, но и как инструмент подготовки данных к анализу.

И тогда вопросы обеспечения безопасности данных, поступающих из внешних источников, должны иметь решения, соответствующие объемам собираемой информации. Так как методы анализа Big Data развиваются пока только вслед за ростом объема данных, большую роль играет свойство аналитических платформ использовать новые методы подготовки и агрегирования данных. Это говорит о том, что, например, данные о потенциальных покупателях или массивное хранилище данных с историей кликов на сайтах online-магазинов могут быть интересны для решения разных задач.

Трудности не останавливают

Несмотря на все сложности с внедрением Big Data, бизнес намерен увеличивать вложения в это направление. Как следует из данных Gartner , в 2013 году 64% крупнейших мировых компаний уже инвестировали, либо имеют планы инвестировать в развертывание технологий в области Big Data для своего бизнеса, тогда, как в 2012 году таких было 58%. По данным исследования Gartner, лидерами инвестирующих в Big Data отраслей являются медиа компании, телеком, банковский сектор и сервисные компании. Успешные результаты внедрения Big Data уже достигнуты многими крупными игроками в сфере розничной торговли в части использования данных, полученных с помощью инструментов радиочастотной идентификации, систем логистики и репленишмента (от англ. replenishment - накопление, пополнение – R&T), а также из программ лояльности. Удачный опыт ритейла стимулирует другие отрасли рынка находить новые эффективные способы монетизации больших данных, чтобы превратить их анализ в ресурс, работающий на развитие бизнеса. Благодаря этому, по прогнозам экспертов, в период до 2020 года инвестиции в управление, хранение снизятся на каждый гигабайт данных с 2$ до 0,2$, а вот на изучение и анализ технологических свойств Big Data вырастут всего на 40%.

Расходы, представленные в различных инвестиционных проектах в области Big Data, имеют разный характер. Статьи затрат зависят от видов продуктов, которые выбираются, исходя из определенных решений. Наибольшая часть затрат в инвестиционных проектах, по мнению специалистов, приходится на продукты, связанные со сбором, структурированием данных, очисткой и управлением информацией.

Как это делается

Существует множество комбинаций программного и аппаратного обеспечения, которые позволяют создавать эффективные решения Big Data для различных бизнес дисциплин: от социальных медиа и мобильных приложений, до интеллектуального анализа и визуализации коммерческих данных. Важное достоинство Big Data – это совместимость новых инструментов с широко используемыми в бизнесе базами данных, что особенно важно при работе с кросс-дисциплинарными проектами, например, такими как организация мульти-канальных продаж и поддержки покупателей.

Последовательность работы с Big Data состоит из сбора данных, структурирования полученной информации с помощью отчетов и дашбордов (dashboard), создания инсайтов и контекстов, а также формулирования рекомендаций к действию. Так как работа с Big Data подразумевает большие затраты на сбор данных, результат обработки которых заранее неизвестен, основной задачей является четкое понимание, для чего нужны данные, а не то, как много их есть в наличии. В этом случае сбор данных превращается в процесс получения исключительно нужной для решения конкретных задач информации.

Например, у телекоммуникационных провайдеров агрегируется огромное количество данных, в том числе о геолокации, которые постоянно пополняются. Эта информация может представлять коммерческий интерес для рекламных агентств, которые могут использовать ее для показа таргетированной и локальной рекламы, а также для ритейлеров и банков. Подобные данные могут сыграть важную роль при решении открытия торговой точки в определенной локации на основе данных о наличии мощного целевого потока людей. Есть пример измерения эффективности рекламы на outdoor-щитах в Лондоне. Сейчас охват подобной рекламы можно измерить лишь поставив возле рекламных конструкций людей со специальным устройством, подсчитывающим прохожих. По сравнению с таким видом измерения эффективности рекламы, у мобильного оператора куда больше возможностей – он точно знает местонахождение своих абонентов, ему известны их демографические характеристики, пол, возраст, семейное положение, и т.д.

На основе таких данных, в будущем открывается перспектива менять содержание рекламного сообщения, используя предпочтения конкретного человека, проходящего мимо рекламного щита. Если данные показывают, что проходящий мимо человек много путешествует, то ему можно будет показать рекламу курорта. Организаторы футбольного матча могут оценить количество болельщиков только когда те придут на матч. Но если бы они имели возможность запросить у оператора сотовой связи информацию, где посетители находились за час, день или месяц до матча, то это дало бы организаторам возможность планировать места для размещения рекламы следующих матчей.

Другой пример – как банки могут использовать Big Data для предотвращения мошенничества. Если клиент заявляет об утере карты, а при совершении покупки с ее помощью банк видит в режиме реального времени месторасположение телефона клиента в зоне покупки, где происходит транзакция, банк может проверить информацию по заявлению клиента, не пытался ли он обмануть его. Либо противоположная ситуация, когда клиент совершает покупку в магазине, банк видит, что карта, по которой происходит транзакция, и телефон клиента находятся в одном месте, банк может сделать вывод, что картой пользуется ее владелец. Благодаря подобным преимуществам Big Data, расширяются границы, которыми наделены традиционные хранилища данных.

Для успешного принятия решения о внедрении решений Big Data компании необходимо рассчитать инвестиционный кейс и это вызывает большие трудности из-за множества неизвестных составляющих. Парадоксом аналитики в подобных случаях становится прогнозирование будущего на основе прошлого, данные о котором зачастую отсутствуют. В этом случае важным фактором является четкое планирование своих первоначальных действий:

- Во-первых, необходимо определить одну конкретную задачу бизнеса, для решения которой будут использоваться технологии Big Data, эта задача станет стержнем определения верности выбранной концепции. Необходимо сосредоточиться на сборе данных, связанных именно с этой задачей, а в ходе проверки концепции вы сможете использовать различные инструменты, процессы и методы управления, которые позволят принимать более обоснованные решения в будущем.

- Во-вторых, маловероятно, что компания без навыков и опыта аналитики данных сможет успешно реализовать проект Big Data. Необходимые знания всегда вытекают из предыдущего опыта аналитики, что является основным фактором, влияющим на качество работы с данными. Важную роль играет культура использования данных, так как часто анализ информации открывает суровую правду о бизнесе, и чтобы принять эту правду и работать с ней, необходимы выработанные методы работы с данными.

- В третьих, ценность технологий Big Data заключается в предоставлении инсайтов Хорошие аналитики остаются дефицитом на рынке. Ими принято называть специалистов, имеющих глубокое понимание коммерческого смысла данных и знающих, как правильно их применять. Анализ данных является средством для достижения целей бизнеса, и чтобы понять ценность Big Data, необходима соответствующая модель поведения и понимание своих действий. В этом случае большие данные дадут массу полезной информации о потребителях, на основе которой можно принять полезные для бизнеса решения.

Несмотря на то, что российский рынок Big Data только начинает формироваться, отдельные проекты в этой области уже реализуются достаточно успешно. Некоторые из них успешны в области сбора данных как, например, проекты для ФНС и банка «Тинькофф Кредитные Системы», другие - в части анализа данных и практического применения его результатов: это проект Synqera.

В банке «Тинькофф Кредитные Системы» был реализован проект по внедрению платформы EMC2 Greenplum, которая является инструментом для массивно-параллельных вычислений. В течение последних лет у банка выросли требования к скорости обработки накопленной информации и анализа данных в режиме реального времени, вызванные высокими темпами роста количества пользователей кредитных карт. Банк объявил о планах расширения использования технологий Big Data, в частности для обработки неструктурированных данных и работы с корпоративной информацией, получаемой из разных источников.

В ФНС России в настоящий момент идет создание аналитического слоя федерального хранилища данных. На его основе создается единое информационное пространство и технология доступа к налоговым данным для статистической и аналитической обработки. В ходе реализации проекта выполняются работы по централизации аналитической информации с более чем 1200 источниками местного уровня ИФНС.

Еще одним интересным примером анализа больших данных в режиме реального времени является российский стартап Synqera, который разработал платформу Simplate. Решение основано на обработке больших массивов данных, программа анализирует информацию о покупателях, историю их покупок, возраст, пол и даже настроение. На кассах в сети косметических магазинов были установлены сенсорные экраны с датчиками, распознающими эмоции покупателей. Программа определяет настроение человека, анализирует информацию о нем, определяет время суток и сканирует базу скидок магазина, после чего отправляет покупателю таргетированные сообщения об акциях и специальных предложениях. Это решение повышает покупательскую лояльность и увеличивает продажи ритейлеров.

Если говорить об иностранных успешных кейсах, то в этом плане интересен опыт применения технологий Big Data в компании Dunkin`Donuts, использующей данные в режиме реального времени для продажи продукции. Цифровые дисплеи в магазинах отображают предложения, сменяющие друг друга каждую минуту, в зависимости от времени суток и наличия продукции. По кассовым чекам компания получает данные, какие именно предложения получили наибольший отклик у покупателей. Данный подход обработки данных позволил увеличить прибыль и оборачиваемость товаров на складе.

Как показывает опыт внедрения Big Data-проектов, эта область призвана успешно решать современные бизнес-задачи. При этом важным фактором достижения коммерческих целей при работе с большими данными является выбор правильной стратегии, которая включает в себя аналитику, выявляющую запросы потребителей, а также использование инновационных технологий в области Big Data.

По данным глобального опроса, ежегодно проводимого Econsultancy и Adobe с 2012 года среди маркетологов компаний, «большие данные», характеризующие действия людей в Интернете, могут многое. Они способны оптимизировать оффлайновые бизнес-процессы, помочь понять как владельцы мобильных девайсов пользуются ими для поиска информации или просто «сделать маркетинг лучше», т.е. эффективнее. Причем, последняя функция год от года все популярнее, как это следует из приведенной нами диаграммы.

Основные области работы интернет-маркетологов с точки зрения отношений с покупателями

Источник

: Econsultancy and Adobe, опубликовано

– emarketer.com

Заметим, что национальность респондентов большого значения не имеет. Как показывает опрос, проведенный KPMG в 2013 году, доля «оптимистов», т.е. тех, кто использует Big Data при разработке бизнес-стратегии, составляет 56%, причем, колебания от региона к региону невелики: от 63% в североамериканских странах до 50% в EMEA.

Использование Big Data в различных регионах мира

Источник

: KPMG, опубликовано

– emarketer.com

Между тем, отношение маркетологов к подобным «модным трендам» в чем-то напоминает известный анекдот:

Скажи, Вано, ты помидоры любишь?

- Поесть люблю, а так – нет.

Несмотря на то, что маркетологи на словах «любят» Big Data и вроде бы даже их используют, на самом деле, «все сложно», как пишут о своих сердечных привязанностях в соцсетях.

По данным опроса, проведенного компанией Circle Research в январе 2014 года среди европейских маркетологов, 4 из 5 опрошенных не используют Big Data (при том, что они их, конечно, «любят»). Причины разные. Закоренелых скептиков немного – 17% и ровно столько же, сколько и их антиподов, т.е. тех, кто уверенно отвечает: «Да». Остальные – это колеблющиеся и сомневающиеся, «болото». Они уходят от прямого ответа под благовидными предлогами в духе того, что «пока нет, но скоро» или «подождем, пока остальные начнут».

Использование Big Data маркетологами, Европа, январь 2014

Источник:

dnx,

опубликовано –

emarketer.

com

Что же их смущает? Сущие пустяки. Некоторые (их ровно половина) попросту не верят этим данным. Другие (их тоже немало – 55%) затрудняются в соотнесении между собой множеств «данных» и «пользователей». У кого-то просто (выразимся политкорректно) внутрикорпоративный беспорядок: данные бесхозно гуляют между маркетинговыми отделами и IT структурами. У других софт не справляется с наплывом работы. И так далее. Поскольку суммарные доли существенно превышают 100%, понятно, что ситуация «множественных барьеров» встречается нередко.

Барьеры, препятствующие использованию Big Data в маркетинге

Источник:

dnx,

опубликовано –

emarketer.

com

Таким образом, приходится констатировать, что пока «Большие данные» - это большой потенциал, которым еще надо суметь воспользоваться. Кстати говоря, именно это может быть и стало причиной того, что Big Data утрачивают ореол «модного тренда», как об этом свидетельствуют данные опроса, проведенного уже упомянутой нами компании Econsultancy.

Самые значимые тренды в диджитал-маркетинге 2013-2014

Источник

: Econsultancy and Adobe

На смену им выходит другой король – контент-маркетинг. Надолго ли?

Нельзя сказать, что Большие Данные – это какое-то принципиально новое явление. Большие источники данных существуют уже много лет: базы данных по покупкам клиентов, кредитным историям, образу жизни. И в течение многих лет ученые использовали эти данные, чтобы помогать компаниям оценивать риск и прогнозировать будущие потребности клиентов. Однако сегодня ситуация изменилась в двух аспектах:

Появились более сложные инструменты и методы для анализа и сочетания различных наборов данных;

Эти аналитические инструменты дополнены целой лавиной новых источников данных, вызванной переходом на цифровые технологии практически всех методов сбора и измерения данных.

Диапазон доступной информации одновременно и вдохновляет, и пугает исследователей, выросших в структурированной исследовательской среде. Потребительские настроения фиксируются сайтами и всевозможными разновидностями социальных медиа. Факт просмотра рекламы фиксируется не только телевизионными приставками, но и с помощью цифровых тегов и мобильных устройств, общающихся с телевизором.

Поведенческие данные (такие как число звонков, покупательские привычки и покупки) теперь доступны в режиме реального времени. Таким образом, многое из того, что раньше можно было получить с помощью исследований, сегодня можно узнать с помощью источников больших данных. И все эти информационные активы генерируются постоянно, независимо от каких бы то ни было исследовательских процессов. Эти изменения и заставляют нас задаться вопросом: смогут ли большие данные заменить собой классические исследования рынка.

Дело не в данных, дело в вопросах и ответах

Прежде чем заказывать похоронный звон по классическим исследованиям, мы должны напомнить себе, что решающее значение имеет не наличие тех или иных активов данных, а нечто иное. Что именно? Наша способность отвечать на вопросы, вот что. У нового мира больших данных есть одна забавная черта: результаты, полученные на основе новых информационных активов, приводят к появлению еще большего количества вопросов, а на эти вопросы, как правило, лучше всего отвечают традиционные исследования. Таким образом, по мере роста больших данных мы видим параллельный рост наличия и потребности в «маленьких данных» (small data), которые могут дать ответы на вопросы из мира больших данных.

Рассмотрим ситуацию: крупный рекламодатель проводит постоянный мониторинг трафика в магазинах и объемов продаж в режиме реального времени. Существующие исследовательские методики (в рамках которых мы опрашиваем участников исследовательских панелей об их мотивациях к покупке и поведении в точках продаж) помогают нам лучше нацелиться на определенные сегменты покупателей. Эти методики могут быть расширены – они могут включать в себя более широкий диапазон активов больших данных вплоть до того, что большие данные становятся средством пассивного наблюдения, а исследования – методом постоянного узкоцелевого исследования изменений или событий, требующих изучения. Именно так большие данные могут освободить исследования от лишней рутины. Первичные исследования уже не должны фокусироваться на том, что происходит (это сделают большие данные). Вместо этого первичные исследования могут сосредоточиться на объяснении того, почему мы наблюдаем те или иные тенденции или отклонения от тенденций. Исследователь сможет меньше думать о получении данных, и больше – о том, как их проанализировать и использовать.

В то же время мы видим, что большие данные позволяют решать одну из наших самых больших проблем – проблему чрезмерно длинных исследований. Изучение самих исследований показало, что чрезмерно раздутые исследовательские инструменты оказывают негативное воздействие на качество данных. Хотя многие специалисты в течение длительного времени признавали наличие этой проблемы, они неизменно отвечали на это фразой: «Но ведь эта информация нужна мне для высшего руководства», и длинные опросы продолжались.

В мире больших данных, где количественные показатели можно получить с помощью пассивного наблюдения, этот вопрос становится спорным. Опять же, давайте вспомним обо всех этих исследованиях, касающихся потребления. Если большие данные дают нам инсайты о потреблении с помощью пассивного наблюдения, то первичным исследованиям в форме опросов уже не надо собирать такого рода информацию, и мы сможем, наконец, подкрепить свое видение коротких опросов не только благими пожеланиями, но и чем-то реальным.

Big Data нуждаются в вашей помощи

Наконец, «большие» - это лишь одна из характеристик больших данных. Характеристика «большие» относится к размеру и масштабу данных. Конечно, это основная характеристика, поскольку объем этих данных выходит за рамки всего того, с чем мы работали прежде. Но другие характеристики этих новых потоков данных также важны: они зачастую плохо форматированы, неструктурированны (или, в лучшем случае, структурированы частично) и полны неопределенности. Развивающаяся область управления данными, метко названная «анализ сущностей» (entity analytics), призвана решить проблему преодоления шума в больших данных. Ее задача – проанализировать эти наборы данных и выяснить, сколько наблюдений относится к одному и тому же человеку, какие наблюдения являются текущими, и какие из них – пригодны для использования.

Такой вид очистки данных необходим для того, чтобы удалить шум или ошибочные данные при работе с активами больших или небольших данных, но этого недостаточно. Мы также должны создать контекст вокруг активов больших данных на основе нашего предыдущего опыта, аналитики и знания категории. На самом деле, многие аналитики указывают на способность управлять неопределенностью, присущей большим данным, как источник конкурентного преимущества, так как она позволяет принимать более эффективные решения.

И вот тут-то первичные исследования не только оказываются освобожденными от рутины благодаря большим данным, но и вносят свой вклад в создание контента и анализ в рамках больших данных.

Ярким примером этого может служить приложение нашей новой принципиально иной рамочной модели капитала бренда к социальным медиа (речь идет о разработанном в Millward Brown новом подходе к измерению ценности бренда The Meaningfully Different Framework – «Парадигма значимых отличий » - R & T ). Эта модель проверена на поведении в рамках конкретных рынков, реализована на стандартной основе, и ее легко применить в других маркетинговых направлениях и информационных системах для поддержки принятия решений. Другими словами, наша модель капитала бренда, опирающаяся на исследования методом опросов (хотя и не только на них) обладает всеми свойствами, необходимыми для преодоления неструктурированного, несвязного и неопределенного характера больших данных.

Рассмотрим данные по потребительским настроениям, предоставляемые социальными медиа. В сыром виде пики и спады потребительских настроений очень часто минимально коррелируют с параметрами капитала бренда и поведения, полученными в оффлайне: в данных просто слишком много шума. Но мы можем уменьшить этот шум, применяя наши модели потребительского смысла, дифференциации брендов, динамики и отличительных черт к сырым данным потребительских настроений – это способ обработки и агрегации данных социальных медиа по этим измерениям.

После того, как данные организованы в соответствии с нашей рамочной моделью, выявленные тренды обычно совпадают с параметрами капитала бренда и поведения, полученными в оффлайне. По сути, данные социальных медиа не могут говорить сами за себя. Чтобы использовать их для указанной цели требуется наш опыт и модели, выстроенные вокруг брендов. Когда социальные медиа дают нам уникальную информацию, выраженную на том языке, который потребители используют для описания брендов, мы должны использовать этот язык при создании своих исследований, чтобы сделать первичные исследования гораздо более эффективными.

Преимущества освобожденных исследований

Это возвращает нас к тому, что большие данные не столько заменяют исследования, сколько освобождают их. Исследователи будут освобождены от необходимости создавать новое исследование по каждому новому случаю. Постоянно растущие активы больших данных могут быть использованы для разных тем исследований, что позволяет последующим первичным исследованиям углубиться в тему и заполнить имеющиеся пробелы. Исследователи будут освобождены от необходимости полагаться на чрезмерно раздутые опросы. Вместо этого они смогут использовать краткие опросы и сосредоточиться на самых важных параметрах, что повышает качество данных.

Благодаря такому освобождению исследователи смогут использовать свои отработанные принципы и идеи, чтобы добавить точности и смысла активам больших данных, что приведет к появлению новых областей для исследований методом опроса. Этот цикл должен привести к более глубокому пониманию по целому ряду стратегических вопросов и, в конечном счете, к движению в сторону того, что всегда должно быть нашей главной целью - информировать и улучшать качество решений, касающихся бренда и коммуникаций.

Под термином Big Data обычно имеют в виду любое количество структурированных, полуструктурированных и неструктурированных данных. Впрочем вторые и третьи могут и должны быть упорядочены для последующего анализа информации. Большие данные не приравниваются к какому-либо фактически объему, но говоря о Big Data в большинстве случаев имеются в виду терабайты, петабайты и даже экстрабайты информации. Такой объем данных может скопиться у любого бизнеса со временем, или, в случаях когда компании необходимо получать много информации, в режиме реального времени.

Анализ больших объемов данных

Говоря об анализе Big Data, в первую очередь имеется в виду сбор и хранение информации из разных источников. Например, данные о клиентах совершивших покупки, их характеристики, информация о запущенных рекламных компаниях и оценка ее эффективности, данные контактного центра. Да, всю эту информацию, можно сопоставить и анализировать. Можно и нужно. Но для этого нужно настроить систему, позволяющую собирать и преобразовывать , не искажая информацию, хранить ее и, наконец, визуализировать. Согласитесь, при больших данных таблицы, распечатанные на нескольких тысячах страниц, мало чем помогут для принятия бизнес-решений.

1. Поступление больших данных

В большинстве сервисов, собирающих информацию о действиях пользователей, есть возможность экспорта . Чтобы они поступали в компанию в структурированном виде используются различные , например, Alteryx. Это ПО позволяет получать в автоматическом режиме информацию, обрабатывать ее, но самое главное — преобразовывать в нужный вид и формат не искажая.

2. Хранение и обработка больших данных

Почти всегда при сборе больших массивов информации встает проблема ее хранения. Из всех платформ, которые мы изучали, наша компания отдает предпочтение Vertica. В отличии от других продуктов, Vertica способна быстро «отдавать» сохраненную в ней информацию. К недостаткам можно отнести долгую запись, но во время анализа больших данных — на первый план выходит скорость отдачи. Например, если мы говорим о составлении , использующего петабайт информации, скорость отдачи — одна из важнейших характеристик.

3. Визуализация Big Data

И наконец, третий этап анализа больших объемов данных — . Для этого необходима платформа, которая способна наглядно отразить всю поступившую информацию в удобном для виде. На наш взгляд, справится с задачей может всего один софтверный продукт — Tableau. Безусловно, одно из лучших на сегодняшних дней решение, которое способно показать визуально любую информацию, превращая работу компании в трехмерную модель, собирая действия всех подразделений в единую взаимозависимую цепь (больше о возможностях Tableau вы можете прочесть ).

Вместо итога отметим, что формировать собственные Big Data сейчас может почти любая компания. Анализ больших данных перестает быть сложным и дорогим процессом. От руководства компании теперь требуется правильно формулировать вопросы к собранной информации, в то время как невидимых серых зон практически не остается.

Скачать Tableau

Система сообщает, что не удалось воспроизвести проверочный звук: причины сбоя и методы устранения проблемы

Система сообщает, что не удалось воспроизвести проверочный звук: причины сбоя и методы устранения проблемы 1 не обновляется через центр обновления

1 не обновляется через центр обновления Виртуальная машина на флешке Запуск виртуальной машины с флешки

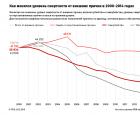

Виртуальная машина на флешке Запуск виртуальной машины с флешки Какая страна известна наименьшим количеством самоубийств

Какая страна известна наименьшим количеством самоубийств